Tecnologia Científica

Como o cérebro lida com o 'problema da festa de coquetel'

Utilizando um modelo computacional, neurocientistas demonstraram como o cérebro pode focar seletivamente a atenção em uma voz específica dentre outras em um ambiente ruidoso.

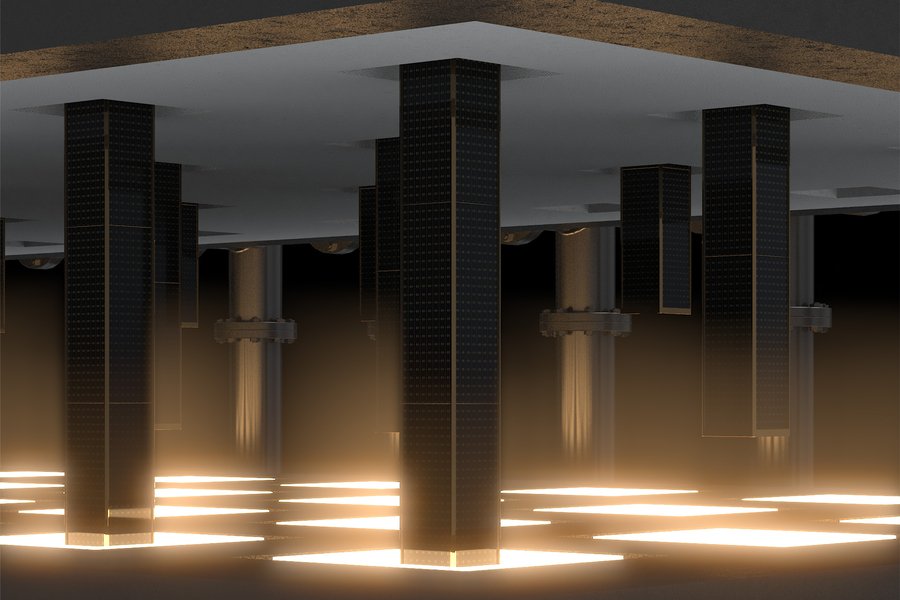

Josh McDermott (à esquerda), professor de ciências cerebrais e cognitivas e pesquisador associado do Instituto McGovern, está sentado com o estudante de pós-graduação Ian Griffith na sala de alto-falantes onde realizaram o estudo. Créditos: Foto: Steph Stevens

Neurocientistas do MIT descobriram como o cérebro consegue se concentrar em uma única voz em meio a uma cacofonia de muitas vozes, lançando luz sobre um fenômeno neurocientífico de longa data conhecido como o problema da festa de coquetel.

Essa capacidade de concentração torna-se necessária em ambientes movimentados, como uma festa, com muitas conversas acontecendo simultaneamente. De alguma forma, seu cérebro consegue acompanhar a voz da pessoa com quem você está falando, apesar de todas as outras vozes ao fundo.

Utilizando um modelo computacional do sistema auditivo, a equipe do MIT descobriu que amplificar a atividade das unidades de processamento neural que respondem a características de uma voz-alvo, como sua altura tonal, permite que essa voz seja destacada e passe para o primeiro plano da atenção.

“Esse motivo simples é suficiente para fazer emergir grande parte do fenótipo da atenção auditiva humana, e o modelo acaba reproduzindo uma ampla gama de comportamentos atencionais humanos para o som”, diz Josh McDermott, professor de ciências cerebrais e cognitivas do MIT, membro do Instituto McGovern de Pesquisa Cerebral e do Centro para Cérebros, Mentes e Máquinas do MIT, e autor sênior do estudo.

Os resultados são consistentes com estudos anteriores que mostram que, quando pessoas ou animais se concentram em um estímulo auditivo específico, os neurônios do córtex auditivo que respondem às características do estímulo-alvo amplificam sua atividade. Este é o primeiro estudo a demonstrar que esse reforço extra é suficiente para explicar como o cérebro resolve o problema da festa de coquetel.

Ian Griffith, estudante de pós-graduação no Programa de Biociências e Tecnologia da Fala e Audição de Harvard, orientado por McDermott, é o autor principal do artigo. O estudante de pós-graduação do MIT, R. Preston Hess, também é um dos autores do artigo, publicado hoje na revista Nature Human Behavior .

Modelagem da atenção

Neurocientistas estudam o fenômeno da atenção seletiva há décadas. Muitos estudos em pessoas e animais mostraram que, ao focar em um estímulo específico, como o som da voz de alguém, os neurônios sintonizados com características dessa voz — por exemplo, tons agudos — amplificam sua atividade.

Quando essa amplificação ocorre, as taxas de disparo dos neurônios aumentam, como se fossem multiplicadas por um número maior que um. Foi proposto que esses "ganhos multiplicativos" permitem que o cérebro concentre sua atenção em certos estímulos. Neurônios que não estão sintonizados com a característica alvo exibem uma redução correspondente na atividade.

“As respostas dos neurônios sintonizados com características que estão no alvo da atenção são amplificadas”, diz Griffith. “Esses efeitos são conhecidos há muito tempo, mas o que não estava claro era se esse efeito era suficiente para explicar o que acontece quando você tenta prestar atenção a uma voz ou focar seletivamente em um objeto.”

Essa questão permanece sem resposta porque os modelos computacionais de percepção não conseguiram realizar tarefas atencionais, como distinguir uma voz dentre várias. Tais modelos conseguem executar tarefas auditivas com facilidade quando há um som-alvo inequívoco a ser identificado, mas não conseguem realizá-las quando outros estímulos competem pela sua atenção.

“Nenhum dos nossos modelos teve a capacidade que os humanos têm, de serem alertados para um objeto específico ou um som específico e, em seguida, basearem sua resposta nesse objeto ou nesse som. Essa tem sido uma limitação real”, diz McDermott.

Neste estudo, a equipe do MIT queria verificar se seria possível treinar modelos para executar esses tipos de tarefas, permitindo que o modelo produzisse aumentos na atividade neuronal semelhantes aos observados no cérebro humano.

Para isso, eles começaram com uma rede neural que eles e outros pesquisadores já haviam usado para modelar a audição e, em seguida, modificaram o modelo para permitir que cada um de seus estágios implementasse ganhos multiplicativos. Nessa arquitetura, a ativação das unidades de processamento dentro do modelo pode ser aumentada ou diminuída dependendo das características específicas que representam, como a altura do som.

Para treinar o modelo, em cada tentativa, os pesquisadores primeiro forneciam a ele uma "pista": um trecho de áudio da voz à qual eles queriam que o modelo prestasse atenção. As ativações das unidades produzidas pela pista determinavam então os ganhos multiplicativos que eram aplicados quando o modelo ouvia um estímulo subsequente.

“Imagine que a deixa seja um trecho de uma voz com um tom grave. Nesse caso, as unidades do modelo que representam tons graves seriam multiplicadas por um ganho alto, enquanto as unidades que representam tons agudos seriam atenuadas”, diz Griffith.

Em seguida, o modelo recebeu trechos de áudio com uma mistura de vozes, incluindo a voz alvo, e foi solicitado a identificar a segunda palavra dita pela voz alvo. As ativações do modelo em resposta a essa mistura foram multiplicadas pelos ganhos resultantes do estímulo de sinalização anterior. Esperava-se que isso causasse uma "amplificação" da voz alvo dentro do modelo, mas não estava claro se esse efeito seria suficiente para produzir um comportamento atencional semelhante ao humano.

Os pesquisadores descobriram que, sob diversas condições, o modelo teve um desempenho muito semelhante ao dos humanos e tendeu a cometer erros parecidos com os que os humanos cometem. Por exemplo, assim como os humanos, às vezes ele cometia erros ao tentar se concentrar em uma de duas vozes masculinas ou em uma de duas vozes femininas, que têm maior probabilidade de apresentar tons semelhantes.

“Realizamos experimentos para medir a capacidade das pessoas de selecionar vozes em uma ampla gama de condições, e o modelo reproduz o padrão de comportamento muito bem”, diz Griffith.

Efeitos da localização

Pesquisas anteriores demonstraram que, além da altura tonal, a localização espacial é um fator crucial que ajuda as pessoas a se concentrarem em uma voz ou som específico. A equipe do MIT descobriu que o modelo também aprendeu a usar a localização espacial para a seleção da atenção, apresentando melhor desempenho quando a voz alvo estava em um local diferente das vozes distratoras.

Em seguida, os pesquisadores usaram o modelo para descobrir novas propriedades da atenção espacial humana. Usando seu modelo computacional, eles conseguiram testar todas as combinações possíveis de locais-alvo e locais de distração, uma tarefa que seria extremamente demorada com participantes humanos.

“Você pode usar o modelo como uma forma de analisar um grande número de condições para procurar padrões interessantes e, uma vez que encontrar algo interessante, pode realizar o experimento em humanos”, diz McDermott.

Esses experimentos revelaram que o modelo era muito mais eficiente na seleção correta da voz alvo quando o alvo e o distrator estavam em locais diferentes no plano horizontal. Quando os sons estavam separados no plano vertical, essa tarefa se tornava muito mais difícil. Quando os pesquisadores realizaram um experimento semelhante com participantes humanos, observaram o mesmo resultado.

“Esse foi apenas um exemplo de como conseguimos usar o modelo como um motor para descobertas, o que eu acho que é uma aplicação empolgante para esse tipo de modelo”, diz McDermott.

Outra aplicação que os pesquisadores estão explorando é o uso desse tipo de modelo para simular a audição por meio de um implante coclear. Eles esperam que esses estudos possam levar a melhorias nos implantes cocleares, ajudando as pessoas com esses implantes a concentrarem sua atenção com mais sucesso em ambientes ruidosos.

A pesquisa foi financiada pelos Institutos Nacionais de Saúde.